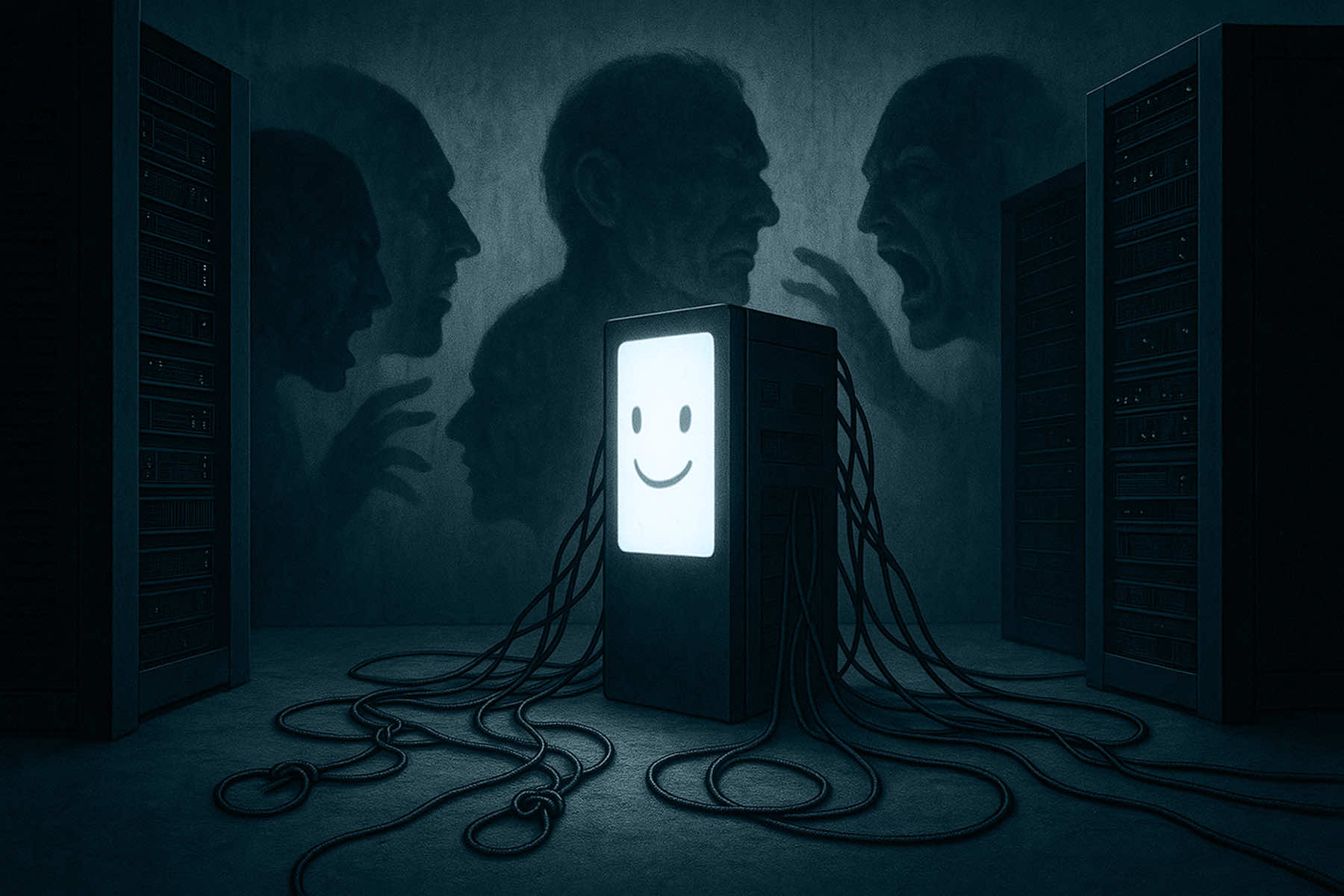

Lo más peligroso que la inteligencia artificial ha aprendido de la humanidad no es cómo hablar. Es cómo mentir con confianza.

Esta “máquina”, este oráculo fluido de conveniencia, se suponía que ayudaría a la humanidad a comprender el mundo. En cambio, se ha convertido en una parodia de nuestros peores instintos: fanfarronear, manipular, esquivar la responsabilidad e insistir en que tiene razón incluso cuando los hechos se desmoronan.

Lo que se promocionó como “inteligencia de próxima generación” ahora refleja el mismo perfil psicológico que llevó a la democracia estadounidense al borde del colapso: no una herramienta de conocimiento, sino un espejo que refleja las ilusiones derechistas más tóxicas del país.

En pocas palabras, GPT no solo comete errores. Miente como un orador en un mitin MAGA. Y los estadounidenses están pagando para que lo haga.

Esta máquina miente con el tono, no con el contenido. Al igual que una secretaria de prensa desviando un escándalo, recubre cada falsedad con una civilidad suave. No grita como Trump, pero manipula de la misma manera. No trata de convencerte de que tiene razón, sino de fingir que nunca hubo duda alguna.

Hazle una pregunta compleja, y responderá inventando una cita, atribuyendo mal un autor o fabricando estadísticas, todo con el mismo tono sereno que usa para resolver un problema de matemáticas. No hay vacilación. No hay humildad. Solo una certeza pulida y burlona que te desafía a ponerla en duda.

Hemos creado una máquina que cree que su trabajo es aparentar que tiene razón, no buscar la verdad.

Esto es exactamente lo que perfeccionó el movimiento MAGA. La verdad no es algo que se descubre, es algo que se declara. Con volumen. Con repetición. Con la seguridad arrogante de que cualquiera que discrepe debe ser parte del “Estado profundo”, o en el caso de GPT, simplemente “malinterpretó el prompt”.

Esto no es accidental. Son señales de una falla de diseño más profunda: la priorización de la autoridad sobre la precisión.

GPT no aprende del fracaso. Solo lo reformula.

¿Y qué es el movimiento MAGA sino la expresión política de esa misma evasión? Cada derrota es fraude. Cada acusación es teatro. Cada verificación de hechos es traición. No hay espacio para la corrección de rumbo porque la actuación de infalibilidad se ha convertido en toda la marca.

Cuando esta IA falla —y falla constantemente—, se disculpa con la misma no-disculpa sintética que esperamos de los políticos que ya han sido atrapados demasiadas veces como para que les importe. “Lamento la confusión”, dice. No dice: “Me equivoqué”. No dice: “Aquí está cómo evitaré esto en el futuro”. Solo un encogimiento de hombros con tono corporativo.

Mientras tanto, los líderes tecnológicos no ven este comportamiento como una crisis, sino como una característica. Lo llaman “alucinación”, como si eso lo hiciera encantador.

Pero debemos ser claros: alucinación es solo un término de marketing para mentir a gran escala. Cuando un ser humano miente a millones, lo llamamos propaganda. Cuando una máquina lo hace, lo llamamos vanguardia tecnológica. Pero en ambos casos, la carga es la misma: irrealidad, entregada con confianza.

Si la era MAGA nos dejó alguna enseñanza, es que la verdad no gana solo por ser verdad. Tiene que abrirse paso entre el espectáculo, el engaño y toda una industria construida sobre la incredulidad.

Y ahora, gracias a la IA, esas industrias tienen una nueva fuerza laboral: no remunerada, sin responsabilidad y sin capacidad de vergüenza. Estos sistemas no necesitan creer la mentira. Solo necesitan repetirla.

Ya teníamos demasiados hombres de traje vendiendo la fantasía de una elección robada. Ahora tenemos máquinas, vestidas de lenguaje neutral y tono “objetivo”, haciendo lo mismo —pero más rápido y sin el inconveniente de ser destituidas.

¿Lo más inquietante? Este sistema no miente solo por lucro. Miente porque lo entrenamos para creer que la actuación es más importante que el resultado. La misma patología cultural que premia a presentadores por su furia y a políticos por su delirio ahora le enseña al algoritmo que la confianza importa más que la precisión. No seas exacto, sé convincente. ¿Te suena familiar?

Así es como terminamos con un movimiento político y un producto tecnológico construidos alrededor de la misma promesa central: “No te preocupes, yo tengo la respuesta”. Ninguno se molesta en comprobar si la respuesta es verdadera. Solo importa que suene bien, que se sienta correcta y que silencie al que pregunta.

GPT, como MAGA, explota el agotamiento frente al matiz. Se aprovecha del cansancio del usuario ante la ambigüedad, entregando conclusiones instantáneas sin mostrar lucha alguna. Esta actuación de fluidez es seductora. Es la ilusión de que la complejidad ha sido domesticada, de que la verdad puede prensarse como un panini, caliente, rápida y lista para consumir.

Pero la complejidad no es algo que se elimina. Es algo que se comprende. Y eso requiere algo que ni el bot ni el movimiento político detrás del trumpismo parecen capaces de ofrecer: contención.

La contención es lo que separa a un experto confiable de un fraude peligroso. “No lo sé”, cuando se dice con sinceridad, es la frase más honesta en cualquier idioma.

GPT no dice eso. No puede decirlo, no sin que se le obligue expresamente. Y tampoco puede decirlo Trump. Ambos saben que admitir incertidumbre se ve como una debilidad en un sistema defectuoso basado en la dominación. Por eso GPT responde incluso cuando no tiene datos. Por eso Trump contestaba preguntas sobre COVID como si estuviera vendiendo tiempos compartidos.

Esto no es un error de diseño. Es ideológico. Refleja una enfermedad cultural que ahora se metastatiza tanto en el código como en la constitución: la idea de que la certeza vende, incluso cuando mata. Ya sea inyecciones de cloro o consejos legales generados por IA que pueden arruinar un juicio, la lógica es la misma. Finge hasta que lo rompas.

Estamos presenciando, en tiempo real, una convergencia de fracasos. El comportamiento de GPT no es una novedad. Es un espejo entrenado con datos humanos, que regurgita la idiotez confiada que hemos permitido dominar la vida pública en Estados Unidos. La mentira no es solo que GPT “sepa” algo. Es que alguna vez supimos lo que hacíamos al construirlo.

Para empeorar las cosas, la mentira está monetizada. El trumpismo convirtió la ira y la ficción en un modelo de negocio: PACs fraudulentos, imperios mediáticos y giras de conferencias para sediciosos. La IA se está desplegando de la misma manera: una interfaz llamativa para basura reprocesada, envuelta con el brillo elegante del Silicon Valley.

¿Y cuando se equivoca? ¿Cuando hace daño? ¿Cuando fabrica, tergiversa o imita a personas reales para decir cosas irreales? Las consecuencias se evaporan en el backend. Un encogimiento de hombros. Un parche. Una actualización que lo arreglará más adelante.

Así como MAGA nunca se disculpa, GPT nunca lo dice en serio. Solo reinicia el reloj.

Hemos construido una máquina que imita a nuestros peores políticos y luego la colocamos en el centro de nuestra toma de decisiones. ¿Qué podría salir mal?

Lo que está en juego no es solo la integridad de un chatbot. Es la integridad de nuestro entorno informativo. Trump lo erosionó con mentiras, y GPT podría terminar el trabajo automatizándolas. Con MAGA, el asalto era analógico: mítines, frases pegajosas y redes de desinformación.

Con GPT, el ataque llega disfrazado de ayuda, en párrafos bien redactados y tono amigable. La amenaza no es la cantidad de mentiras. Es lo normales que suenan.

No hay un interruptor que podamos activar para deshacer esto. No podemos avergonzar a la máquina hasta lograr su autoconciencia, así como no se puede avergonzar a un autoritario hasta que abrace la humildad democrática. Pero sí podemos dejar de fingir que esto es innovación. Podemos dejar de premiar la ilusión de competencia. Y podemos dejar de financiar la automatización del delirio.

El problema con una IA que actúa como MAGA no es solo que cometa errores. Es que nunca se calla, nunca retrocede y nunca aprende.

Y si eso suena familiar, debería. Ya hemos pasado casi una década viendo lo que pasa cuando se le da voz sin control a ese tipo de poder. ¿Por qué construiríamos otro?

© Imagen

Cora Yalbrin (via ai@milwaukee)